Commande oculaire

Les solutions de commande oculaire (eye-tracking) se développent sur ordinateur. Ces solutions permettent d’analyser le comportement visuel d’un utilisateur lors de la consultation d’une page Web ou d’un achat sur internet. Ces solutions permettent aussi aux personnes en incapacité d’utiliser leur main, soit par handicap soit lors d’une situation particulière d’utilisation, de commander leur PC ou des applications dédiées.

L’association « Quelque Chose en Plus » a financé l’achat de solutions professionnelles de commande oculaire dans les deux établissements. Les résultats sont très prometteurs.

Utilisation sur un équipement personnel

Il existe des solutions « open source » pour exploiter la reconnaissance oculaire dans des applications Web (cf. code javascript pour utiliser le pointage oculaire). La qualité / précision de cette reconnaissance n’est évidemment pas au niveau de ce qu’on trouve sur ordinateur : caméra de suivi facial plus grande et écran d’interaction visuelle plus large facilitent la discrimination spatiale du pointage.

Malgré la difficulté de procéder à un pointage visuel sur téléphone, l’idée présentée dans cet article est d’exploiter, au moins dans un premier temps, cette capacité sur un cas d’utilisation simple : proposer à un utilisateur de répondre à une question par oui ou par non en pointant du regard la zone oui ou la zone non sur l’écran d’un téléphone.

Cette application pourrait remplacer les pictogrammes ou les images OUI/NON parfois utilisées par les professionnels ou les familles. L’intérêt de l’application est de toujours être à portée de téléphone : y compris en déplacement, dans n’importe quelle situation.

Difficulté

La difficulté principale rencontrée pour offrir un fonctionnement correct de l’application réside dans l’apprentissage du pointage visuel par le système : l’application doit apprendre à identifier la correspondance entre le pointage visuel et l’endroit de l’écran qui est pointé.

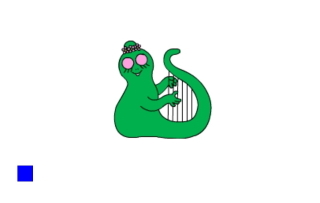

Cette difficulté est vraie pour tous les utilisateurs, la solution fournit dans les codes sources récupérés consiste à calibrer la correspondance en associant les déplacements de la souris et les clics avec le regard de l’utilisateur. Cette solution n’étant pas accessible aux personnes ne pouvant pas utiliser une souris ou taper sur un écran, la solution envisagée consiste à déplacer une image à l’écran pendant la phase de calibrage et considérer que le regard de l’utilisateur pointe sur cette image.

Mode d’emploi

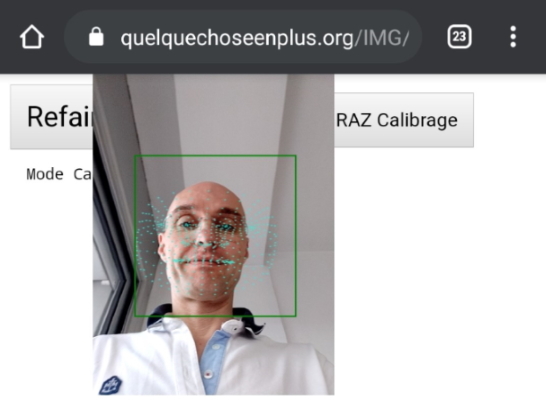

Le matériel requis pour exploiter l’application est un PC, une tablette ou plutôt un téléphone équipé d’une caméra frontale pour reconnaître le visage et le regard de l’utilisateur (pour une fois cette caméra ne servira pas aux selfies !). Vous devez accepter que l’application (concrètement la page Web) accède à la caméra frontale de l’équipement. C’est l’occasion de veiller à ce que la caméra frontale soit propre pour que la reconnaissance ne soit pas obstruée.

(Une fois la page chargée, vous devez attendre quelques secondes avant que l’application ne soit prête à répondre aux sollicitations : l’accès à l’image de la caméra, le chargement du code prend un peu de temps.)

Avant de pouvoir utiliser l’application pour obtenir une réponse de l’utilisateur, la première opération consiste à calibrer le pointage visuel. Ce calibrage est valable pour un utilisateur, un navigateur et pour un appareil (ordinateur, tablette ou téléphone). Un changement d’utilisateur sur un appareil nécessite donc de recalibrer le pointage. A contrario, un smartphone avec plusieurs navigateurs internet peut s’adapter à plusieurs utilisateurs : un navigateur dédié à chaque utilisateur (et calibré pour chacun).

Le calibrage se lance après l’appui sur le bouton « Mode Calibrer » : la vue de la reconnaissance faciale s’affiche quelques secondes avant le calibrage pour s’assurer que l’utilisateur est bien « cadré » par la caméra, la vue disparaît et une image se déplace à l’écran, le regard est considéré comme suivant l’image.

Lorsque le calibrage se déroule bien, au fur et à mesure de l’ajustement, le pointeur bleu (zone identifiée comme le pointage visuel) se rapproche de l’image.

Le calibrage peut être réalisé à tout moment. Plusieurs calibrages peuvent être réalisés si un seul ne donne pas satisfaction. Si la calibration n’est vraiment pas efficace, l’utilisateur peur la reprendre complètement « RAZ Calibrage ». Les données de calibration sont conservées sur l’appareil.

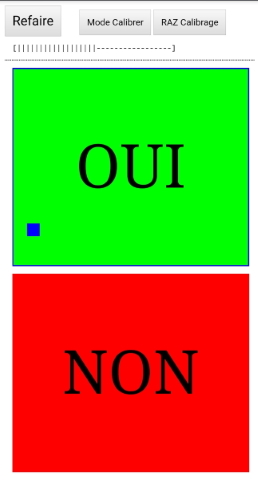

Une fois le calibrage effectué, l’application peut être utilisée pour demander à l’utilisateur de répondre à une question posée.

Le pointage consiste alors, pour l’utilisateur, à regarder le rectangle vert pour répondre positivement à la question ou le rouge pour répondre négativement, il doit conserver son regard dans le rectangle pendant quelques secondes pour valider son choix.

Une fois validé (temps nécessaire écoulé), le choix est figé, l’utilisateur peut alors renouveler l’opération (bouton « Refaire ») pour répondre à une nouvelle question ou pour confirmer son choix.

Note

Cette application est une première version proposée et qui évoluera (ou pas) en fonction de son utilité et des retours des utilisateurs.

Pour démarrer : suivez le lien de l’application ICI.

et copiez le lien dans les favoris de votre navigateur.